¡Tu carrito actualmente está vacío!

De (AGI) a (ASI)

De Inteligencia Artificial General a Super Inteligencia Artificial

AGI-ASI

Este artículo está inspirado en el contenido de Situational Awareness AI & Technological Singularity

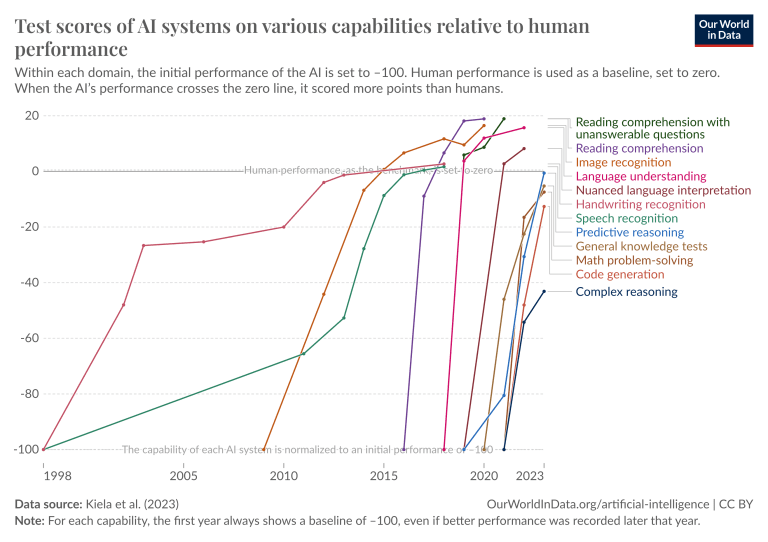

La siguiente grafica muestra que desde el año 2023 los modelos de lenguaje han estado superando al humano evaluación tras evaluación, incluso superándolo en muchos aspectos.

Incluso modelos recientes has superado las pruebas más difíciles de razonamiento complejo, matemáticas y programación.

Entonces supongamos que estos modelos ya son Inteligencia General, similar al humano (AGI) ¿Que significa esto?

Significa que, así como los modelos están sacando mejores calificaciones que los abogados, tendremos los mejores abogados.

Dan mejores diagnósticos que los doctores, tendremos miles de los mejores doctores para todos.

Los mejores programadores.

Los mejores docentes.

Mejores escritores

Todo aquello que requiera creatividad e inteligencia sera mejorado y automatizado.

Nadie sabe si esto sera bueno o malo.

En lo personal yo creo que puede ser muy bueno si sabemos usarlo y compartirlo.

Pero eso es si el progreso se frena en este momento…

¿Y si el progreso sigue avanzando?

Se cree que estos modelos llegaran a un estado de (ASI) Super Inteligencia Artificial

Una inteligencia muy superior a la humana.

Es imposible imaginar que repercusiones tendrá esto en el futuro y aunque suene de ciencia ficción, los pronósticos indican que sucederá más rápido de lo esperado.

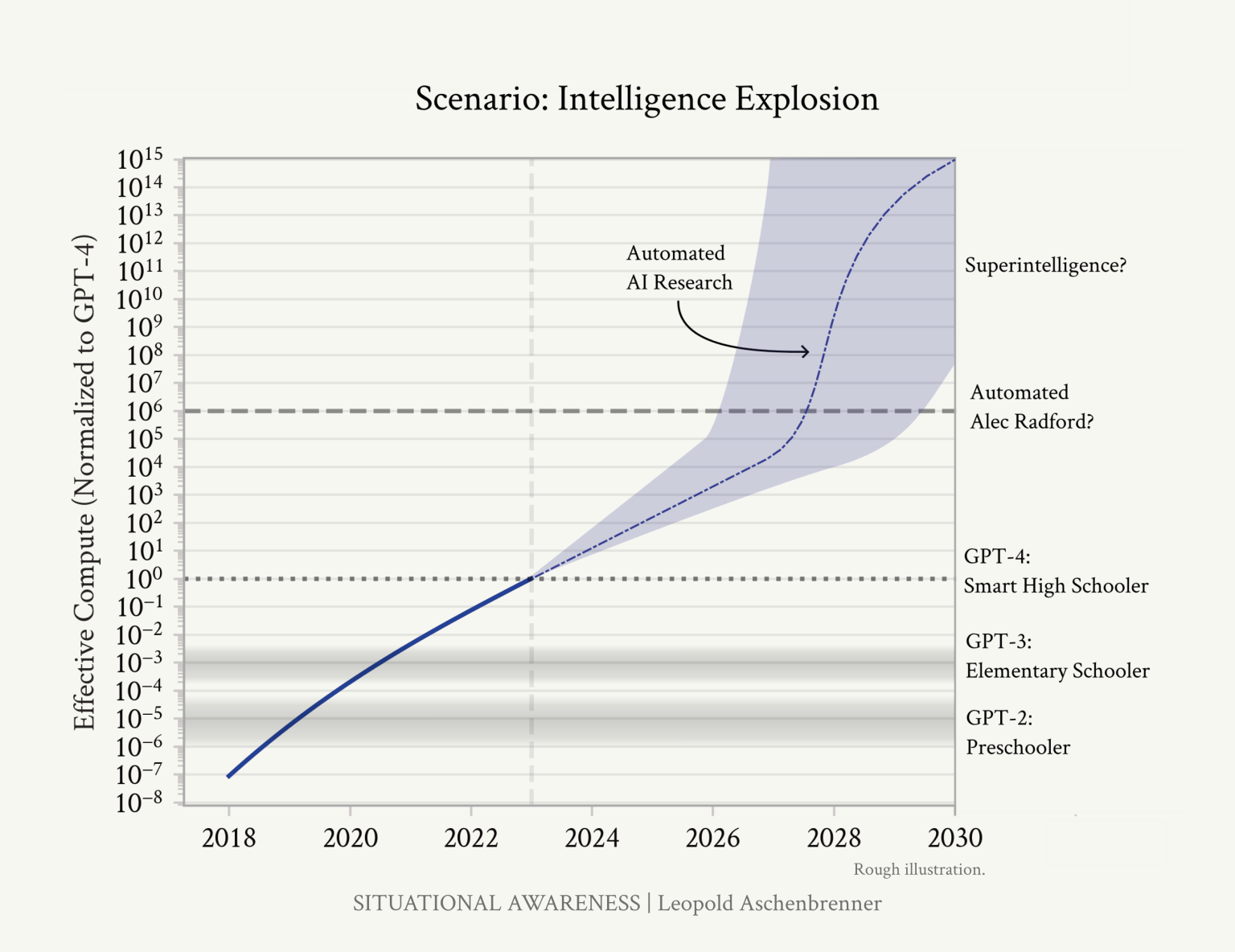

Volvamos a la gráfica del artículo anterior, pero expandamos el tiempo a futuro y supongamos que la IA pasa de ser Inteligencia que razona a inteligencia capaz de innovar y realizar descubrimientos nuevos de manera automatizada.

Explosion

Las tendencias nos dicen que es posible que esta década aparezca una ASI si el crecimiento sigue avanzando igual que los últimos 5 años.

Aunque hay varios cuellos de botella plausibles, incluyendo la computación limitada para experimentos, complementariedades con los humanos y el progreso algorítmico volviéndose más difícil, pero en realidad ninguno de estos cuellos de botella parece suficiente para ralentizar las cosas de manera definitiva.

Antes de que nos demos cuenta, tendremos superinteligencia en nuestras manos, sistemas de IA mucho más inteligentes que los humanos, capaces de comportamientos novedosos, creativos y complicados que ni siquiera podríamos comenzar a entender, quizás incluso una pequeña civilización de miles de millones de ellos.

Su poder también sería inmenso. Al aplicar la superinteligencia a la investigación y desarrollo en otros campos, el progreso explosivo se ampliaría desde la investigación en aprendizaje automático; pronto resolverían la robótica, harían saltos dramáticos en otros campos de la ciencia y la tecnología en unos pocos años, y seguiría una explosión industrial.

La superinteligencia probablemente proporcionaría una ventaja militar decisiva y desataría poderes de destrucción inimaginables. Nos enfrentaremos a uno de los momentos más intensos y volátiles de la historia humana.

No necesitamos automatizar todo, solo la investigación en IA. Una objeción común a los impactos transformadores de la Super Inteligencia es que será difícil para la IA hacer todo. Por ejemplo, algunos dicen que la robótica será un problema complicado, incluso si la IA tiene niveles cognitivos equivalentes a doctorados. O tomar la automatización de la biología, que podría requerir mucho trabajo físico en laboratorios y experimentos con humanos.

Pero no necesitamos la robótica, no necesitamos muchas cosas, para que la IA automatice la investigación en IA. Los trabajos de los investigadores y los ingenieros de IA en los principales laboratorios se pueden realizar completamente de forma virtual y no enfrentan cuellos de botella del mundo real de la misma manera (aunque aún estarán limitados por la capacidad de cómputo). Y el trabajo de un investigador de IA es bastante sencillo, a grandes rasgos: leer la literatura reciente y desarrollar nuevas preguntas o ideas, implementar experimentos para probar esas ideas, interpretar los resultados y repetir. Todo esto parece estar en el dominio donde de la IA podrían fácilmente llevarnos a niveles mejores que los humanos lo han hecho, incluso para finales del 2027.

Vale la pena enfatizar lo directas y sencillas que han sido algunas de las mayores innovaciones en aprendizaje automático de la última década: “vaaa, simplemente agrega algo de normalización” (LayerNorm/BatchNorm) o “haz f(x)+x en lugar de f(x)” (conexiones residuales) o “corrige un error de implementación” (Kaplan → leyes de escalado Chinchilla).

La investigación en IA se puede automatizar. Y automatizar la investigación en IA es todo lo que se necesita para iniciar bucles de retroalimentación extraordinarios.

Podríamos ejecutar millones de copias (y pronto a 10x+ la velocidad humana) de los investigadores de IA automatizados.

Incluso para 2027, deberíamos esperar flotillas de GPU en los millones. Solo los clusters actuales de entrenamiento deberían estar acercándose a ~3 OOM más grandes, lo que ya nos pone en más de 10 millones de equivalentes A100 (tarjetas NVIDIA).

Eso nos permitiría ejecutar muchos millones de copias de nuestros investigadores de IA automatizados, quizás 100 millones de equivalentes de investigadores humanos, trabajando día y noche. Hay algunas suposiciones que fluyen hacia los números exactos, incluyendo que los humanos “piensan” a 100 tokens/minuto (solo una estimación de orden de magnitud, por ejemplo, considera tu monólogo interno, ¿que tan rapido es?)

También querríamos reservar algunas de las GPUs para ejecutar experimentos y entrenar nuevos modelos.

Además, nuestros investigadores de IA automatizados podrían pronto operar a una velocidad mucho mayor que la humana:

La primera innovación algorítmica en la que trabajen los investigadores de IA automatizados será obtener un aumento de velocidad de 10x o 100x.

Por ejemplo: Gemini 1.5 Flash es ~10 veces más rápido que el GPT-4 original, apenas un año después, proporcionando un rendimiento similar al GPT-4 original en los benchmarks de razonamiento.

Si esa es la aceleración algorítmica que unos pocos cientos de investigadores humanos pueden encontrar en un año, los investigadores de IA automatizados podrán encontrar victorias similares muy rápidamente. Eso es: 100 millones de investigadores automatizados trabajando a 100x velocidad humana poco después de que comencemos a poder automatizar la investigación en IA. Cada uno podrá hacer un año de trabajo en unos pocos días.

Esto podría fácilmente acelerar drásticamente las tendencias existentes de progreso algorítmico, comprimiendo una década de avances en un año.

¿Podrían nuestros millones de investigadores de IA automatizados (pronto trabajando a 10x o 100x velocidad humana) comprimir el progreso algorítmico que los investigadores humanos habrían encontrado en una década en un año en su lugar? Eso sería 5+ ordenes de magnitud en un año.

Los verdaderos investigadores de IA automatizados serán muy inteligentes, y además de su ventaja cuantitativa bruta, tendrán otras enormes ventajas sobre los investigadores humanos:

Podrán leer todos los artículos de ML jamás escritos, haber podido pensar profundamente en cada experimento anterior realizado en el laboratorio, aprender en paralelo de cada una de sus copias y acumular rápidamente el equivalente a milenios de experiencia.

Podrán desarrollar intuiciones mucho más profundas sobre ML que cualquier humano. Podrán escribir fácilmente millones de líneas de código complejo, mantener todo el código en contexto y dedicar décadas humanas (o más) a revisar cada línea de código en busca de errores y optimizaciones. Serán extremadamente competentes en todas las partes del trabajo. No tendrás que capacitar individualmente a cada investigador de IA automatizado (de hecho, capacitar y adaptar a 100 millones de nuevos empleados humanos sería difícil). En su lugar, puedes enseñar y adaptar a uno de ellos, y luego hacer réplicas. (Y no tendrás que preocuparte por la política, la aclimatación cultural y cosas por el estilo, y trabajarán con energía y enfoque máximo día y noche).

Grandes cantidades de investigadores de IA automatizados podrán compartir contexto (quizás incluso accediendo al espacio latente de las redes neuronales de los demás), permitiendo una colaboración y coordinación mucho más eficiente en comparación con los investigadores humanos. Y, por supuesto, por muy inteligentes que sean nuestros investigadores de IA automatizados iniciales, pronto podremos hacer saltos adicionales en órdenes de magnitud, produciendo modelos aún más inteligentes, aún más capaces en la investigación automatizada de IA en base a las mejoreas de versiones previas.

Imagina un Alec Radford automatizado; imagina 100 millones de Alec Radfords automatizados. Creo que casi todos los investigadores en OpenAI estarían de acuerdo en que si tuvieran 10 Alec Radfords, por no hablar de 100 o 1,000 o 1 millón operando a 10x o 100x velocidad humana, podrían resolver muy rápidamente muchos de sus problemas. Incluso con varios otros cuellos de botella, comprimir una década de progreso algorítmico en un año como resultado parece muy plausible.

Es sorprendentemente plausible que pasaríamos de AGI a superinteligencia muy rápidamente, tal vez en menos de un año.

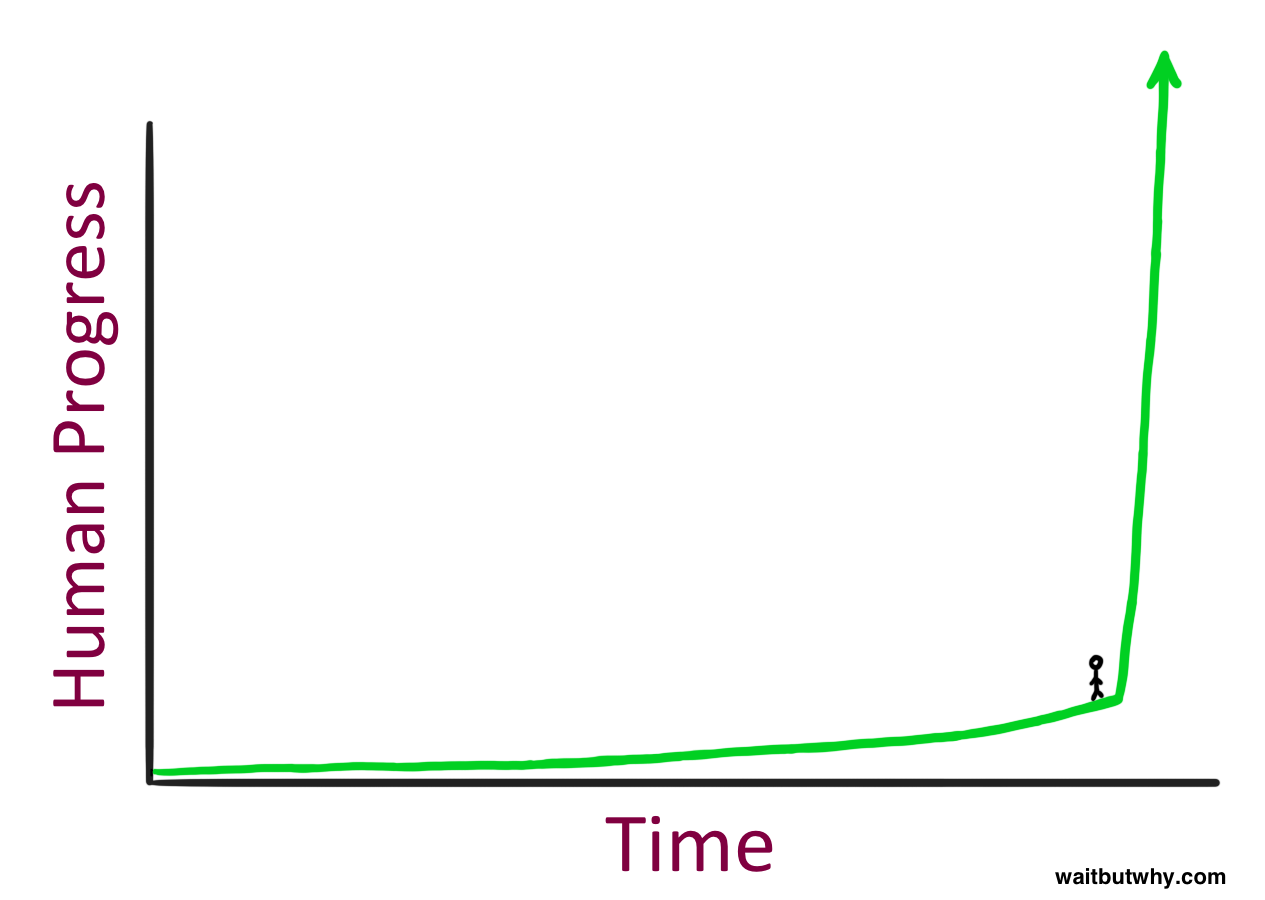

Exponencial

A continuación, te muestro una comparativa del avance tecnológico estable vs exponencial en una gráfica interactiva, úsala para comparar los resultados en diferentes etapas. (Tiempo relativo)

El modelo matemático de I.J. Good (1965) describe este crecimiento como:

\[ I(t) = I_0 \cdot e^{kt} \]

donde:

- \( I(t) \): inteligencia en el tiempo \( t \)

- \( I_0 \): inteligencia inicial

- \( k \): tasa de crecimiento exponencial

Comparación de Crecimiento

Valores Actuales

Esto es solo un fragmento del articulo real

El articulo completo está aquí:

Deja un comentario